用戶在圖文、短視頻平臺連續閱覽某類話題內容時,平臺推薦算法會持續推送相關內容,由此產生的“信息繭房” 問題一直備受行業質疑 。4月15日,抖音“安全與信任中心開放日”現場,相關負責人拆解抖音算法邏輯與審核流程。

推薦算法作為人工智能機器學習技術的應用場景,本質是一套高效信息過濾系統。現場采訪環節,抖音算法工程師劉暢表示,抖音推薦算法與國內外大部分內容推薦平臺相似,包含召回、過濾、排序等環節,重點是學習用戶行為。

目前,抖音基于用戶行為的推薦方法包括協同過濾、雙塔召回、Wide&Deep等多種技術模型。算法可以在完全“不理解內容”的情況下,找到興趣相似的用戶,將其他人感興趣的內容推薦給該用戶。

但同質化選題的密集推送容易造成“信息繭房”現象,對此,抖音相關責任人回應稱:“信息繭房”概念在推薦算法成熟之前就出現了,算法不是“信息繭房”形成的先決因素。現在行業對“信息繭房”的擔心本質是“信息偏食”,即信息來源單一。

當前各渠道分發信息都存在一定局限性,此前包括小紅書、微博、美團、嗶哩嗶哩等平臺均發布了算法治理相關內容。北京師范大學新聞傳播學院教授喻國明表示,“信息繭房”一直存在,本質是海量信息差異化消費的必然結果。

為引導算法打破“信息繭房”,抖音算法在多目標建模體系下,設置了專門的探索維度。一是盡可能推薦更多樣的內容,通過多樣性打散、多興趣召回、扶持小眾(長尾)興趣等方法控制相似內容出現的頻次。二是采用隨機推薦、基于用戶社交關系拓展興趣、搜索推薦聯動、“不感興趣”不再展現等方式,讓用戶的主動行為影響推薦系統,使推薦更加個性化和多樣化。

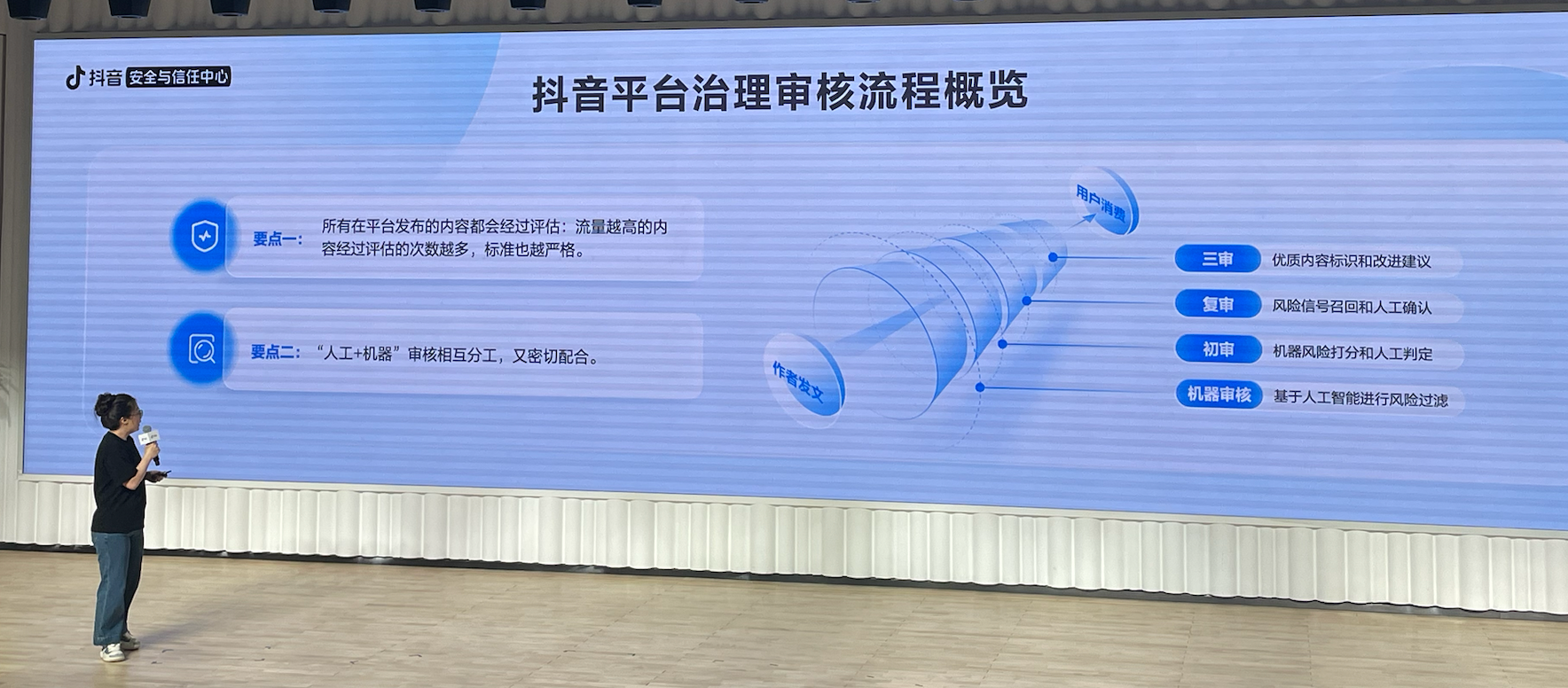

但需注意的是,算法能學習、預估用戶行為,但無法理解內容語義,對內容的理解存在不足,可能導致違法違規、不良內容被推薦傳播。因此,算法必須由平臺治理對其進行約束和規范。抖音生態運營經理陳丹丹表示,抖音內容治理體系實行“人工參與 機器學習”模式,包含異常感知、標準定義、機器識別、人工研判、風險處置等過程。

創作者將內容上傳至抖音后,先進入機器識別環節。如果內容被識別出含有高危特征,將被直接攔截;若未命中高危特征但模型判斷有問題,會被送至人工審核;若問題概率較低,獲得基礎流量進入下一環節。當視頻被舉報、評論區出現集中質疑、流量激增等情況發生,則可能觸發“人工 機器”審核。相關內容在上述任一環節被處置,系統都會立即停止進一步推薦和分發。

幫企客致力于為您提供最新最全的財經資訊,想了解更多行業動態,歡迎關注本站。鄭重聲明:本文版權歸原作者所有,轉載文章僅為傳播更多信息之目的,如作者信息標記有誤,請第一時間聯系我們修改或刪除,多謝。